在当今的科技环境中,GPU服务器因其强大的并行处理能力,逐渐成为许多企业、研究机构和个人用户的首选。与传统的CPU服务器相比,GPU服务器不仅在计算速度上具备明显优势,更在特定领域,如机器学习、深度学习和图形渲染等应用中展现出无与伦比的性能。借助GPU的强大能力,数据处理的效率大幅提升,特别是在处理大量数据时,GPU能够显著缩短时间成本,从而推动创新。

整体而言,GPU服务器的设计目的是为了解决大量数据计算所需的效率问题。传统的CPU虽然在通用计算中依然主导市场,但是当涉及到并行运算时,GPU显然提供了更优越的解决方案。以机器学习为例,训练一个神经网络模型通常涉及到数以千计的运算,GPU的并行架构使得同时处理多个数据点成为可能,大大提升了训练速度,让研究人员可以在更短的时间内完成实验,从而加速理论的验证和实际应用的落地。

在选择GPU服务器时,有几个关键因素需要考虑,包括GPU的型号、数量、内存以及存储配置等。比如,NVIDIA的A100和V100系列显卡因其强大的浮点运算能力,被广泛应用于各种高性能计算任务中。在这些系统中,显卡的数量理论上可以成倍增加,这样可以进一步提升计算能力,适用于极其复杂的运算任务,例如大规模的图像识别或自然语言处理。不过,随之而来的也是更高的成本,用户需要根据自身的需求权衡性能与经济性。

除了硬件配置,GPU服务器的软件生态同样重要。许多开发工具和框架,如TensorFlow、PyTorch和CUDA等,都是专门为GPU优化的,可以有效利用显卡的计算能力。此外,对操作系统的选择和优化也对服务器性能有直接影响。Linux操作系统因其灵活性和开源特性,往往成为GPU服务器的首选。稳定的操作系统与相应的优化工具组合,能够最大程度地释放GPU的性能。

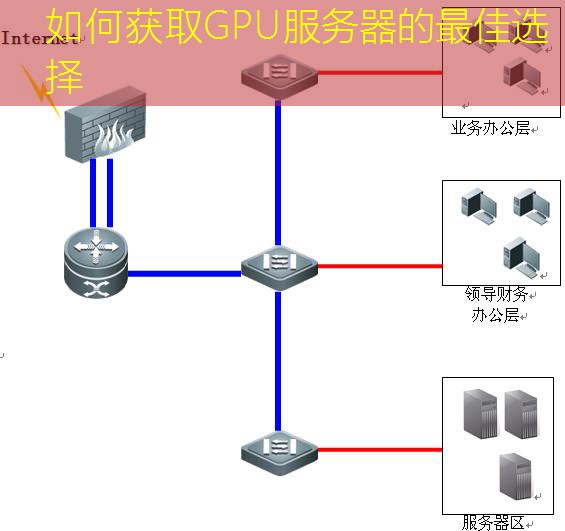

在云计算盛行的今天,越来越多的企业选择将自己的计算需求迁移到云平台。云端的GPU服务器可以按需提供服务,让企业和开发者无需购买昂贵的硬件,而是以更灵活且经济的方式获取所需的计算能力。主流的云服务提供商,如AWS、Google Cloud及Azure等,都推出了相应的GPU实例,支持各种基于GPU的应用。这样一来,企业可以根据项目的需求,不断调整计算资源,避免了硬件投资带来的负担。

关于GPU服务器,有些常见的问题和解答值得了解:

问:GPU服务器适合哪些类型的应用?

答:GPU服务器特别适合需要大量并行计算的应用,比如机器学习、深度学习、图形渲染、科学计算等。在这些领域,GPU的高并行处理能力能够显著提升运算速度和效率。

问:选择GPU服务器时有哪些关键性能指标?

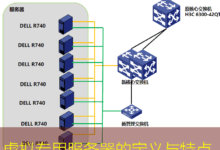

答:选择GPU服务器时,应关注GPU的型号和数量、显存大小、CPU性能、内存容量、存储速度和网络带宽等。这些因素都会直接影响GPU服务器的整体性能表现,尤其在处理复杂计算任务时尤为重要。

问:购买GPU服务器还是租用云端的GPU实例好?

答:这取决于你的需求。如果你有持续性的高需求且预算允许,购买GPU服务器可能更具成本效益。然而,如果你的需求是临时性的,或者在规模上具有不确定性,租用云端的GPU实例则更加灵活和经济。通过云服务,你可以在项目中根据实际需求动态调整计算资源。

当前,随着人工智能、大数据和云计算等技术的快速发展,GPU服务器在各行各业的应用正在不断扩展。不论是大型企业,还是初创公司,都在不同程度上依赖于GPU服务器的强大算力来驱动技术创新和业务发展。未来随着硬件成本降低和技术的不断进步,GPU服务器将变得更加普及,为越来越多的用户提供服务。

综上所述,GPU服务器不仅仅是高性能计算的工具,更是推动技术进步、激发创新的重要力量。在选择和使用工具时,了解自己的需求和各个技术指标,将有助于提供更有效的解决方案。