如何在 VPS 上配置显卡以支持深度学习

在当今的科技环境中,深度学习和 GPU 加速计算已成为许多应用的核心。然而,许多用户可能会在普通的 VPS 上使用 CPU 进行深度学习任务,导致计算效率低下。本文将引导您如何在 VPS 上配置显卡 (GPU) 以支持深度学习任务,帮助您提高模型训练的速度和效率。

操作前的准备

在开始之前,确保您拥有以下内容:

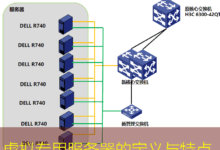

- 显卡支持的 VPS:选择一个支持 NVIDIA GPU 的 VPS 提供商,例如 AWS、Google Cloud 或 Azure。

- 操作系统:通常我们建议使用 Ubuntu 20.04 或更高的版本。

- 管理员权限:确保您有足够的权限来安装软件和驱动程序。

详细操作步骤

1. 更新系统

在开始配置之前,首先需要更新系统软件包。使用以下命令:

sudo apt update && sudo apt upgrade -y2. 安装 NVIDIA 驱动

为了充分利用 GPU,我们需要安装 NVIDIA 驱动程序。请按以下步骤操作:

- 添加 NVIDIA 软件源:

- 更新软件包列表:

- 安装驱动程序:

- 重启系统:

sudo add-apt-repository ppa:graphics-drivers/ppasudo apt updatesudo apt install nvidia-driver-460注意:请根据您的显卡型号选择合适的驱动版本。

sudo reboot重启后,您可以使用 nvidia-smi 命令来检查驱动是否安装成功。

3. 安装 CUDA 和 cuDNN

深度学习库(如 TensorFlow 和 PyTorch)通常依赖 CUDA 和 cuDNN。以下是安装步骤:

- 下载 CUDA Toolkit:

- 添加 CUDA 封装源:

- 添加 NVIDIA GPG 密钥:

- 添加 CUDA 资源库:

- 更新软件包列表并安装 CUDA:

- 配置环境变量:

wget https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2004/x86_64/cuda-ubuntu2004.pinsudo mv cuda-ubuntu2004.pin /etc/apt/preferences.d/cuda-repository-pin-600wget https://developer.download.nvidia.com/compute/cuda/keys/NVIDIA-GPG-KEYsudo apt-key add NVIDIA-GPG-KEYsudo add-apt-repository "deb https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2004/x86_64/ /"sudo apt update && sudo apt install cuda -yecho 'export PATH=/usr/local/cuda-11.2/bin${PATH:+:${PATH}}' >> ~/.bashrcecho 'export LD_LIBRARY_PATH=/usr/local/cuda-11.2/lib64${LD_LIBRARY_PATH:+:${LD_LIBRARY_PATH}}' >> ~/.bashrcsource ~/.bashrc4. 安装必要的深度学习框架

接下来,您可以安装 TensorFlow 或 PyTorch。以下是安装 TensorFlow 的示例:

pip install tensorflow-gpu安装 PyTorch 的方式如下(确保您根据您的 CUDA 版本选择正确的命令):

pip install torch torchvision torchaudio --extra-index-url https://download.pytorch.org/whl/cu113遇到的问题和注意事项

在安装和配置过程中,您可能会遇到以下问题:

- NVIDIA 驱动安装失败:确保您的 VPS 硬件支持所选驱动程序。您可以通过

lspci | grep -i nvidia检查硬件信息。 - CUDA 版本不兼容:确保您 Deep Learning 框架版本与 CUDA 版本相匹配。请查看官方文档获取最新的兼容性信息。

- 库无法找到:确保环境变量配置正确。使用

echo $PATH和echo $LD_LIBRARY_PATH检查配置。

请确保始终检查官方文档以获取最新的版本和兼容性信息,以顺利地配置您的 GPU VPS。